使用流程:

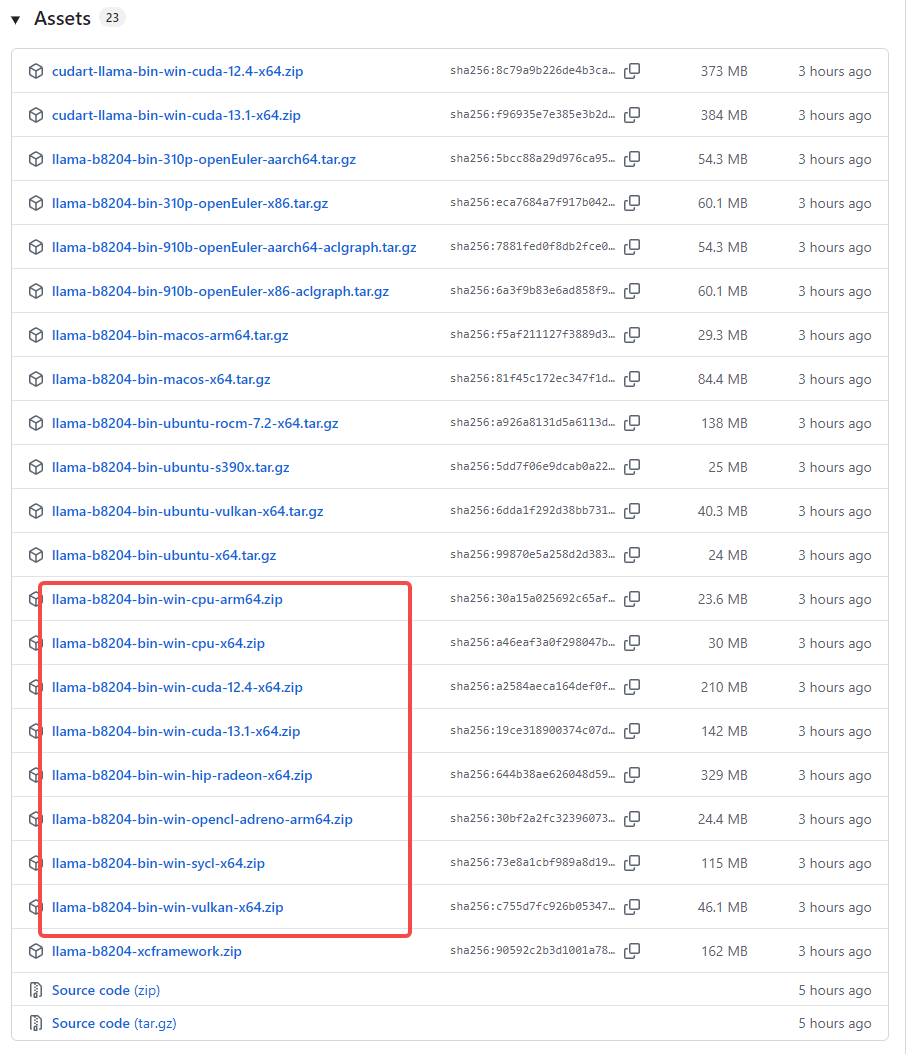

一、下载llama.cpp windows版本的exe程序

https://github.com/ggml-org/llama.cpp/releases

二、下载GGUF格式的模型文件,跟llama放在同一个目录

https://huggingface.co/models?sort=trending&search=Qwen3.5

三、打开CMD,或者在LLama目录 直接运行CMD

#命令行交互方式 llama-cli -m Qwen3.5-0.8B-BF16.gguf #webui界面交互方式 llama-server -m Qwen3.5-0.8B-BF16.gguf --port 8080 llama-server -m Qwen3.5-35B-A3B-UD-IQ3_S.gguf -c 8192 -ngl 999 --port 8080

#关闭思考模式,直接回答问题 llama-server.exe -m gemma-4-E4B-it-Q5_K_M.gguf --jinja --chat-template-kwargs "{\"enable_thinking\":false}" --host 0.0.0.0 --port 8080

GPU启动,解决重复输出相同内容的问题;

llama-cli -m Qwen2.5-Sex.Q8_0.gguf -ngl 999 --repeat-penalty 1.20

如果还是循环,再加 mirostat:

llama-cli -m Qwen2.5-Sex.Q8_0.gguf -ngl 999 --repeat-penalty 1.20 --mirostat 2 --mirostat-lr 0.1 --mirostat-ent 3.0

赞

赞

打赏

打赏  生成海报

生成海报

发表回复

评论列表(0条)